基于神经网络的数控机床热误差建模研究毕业论文

2020-02-17 21:59:37

摘 要

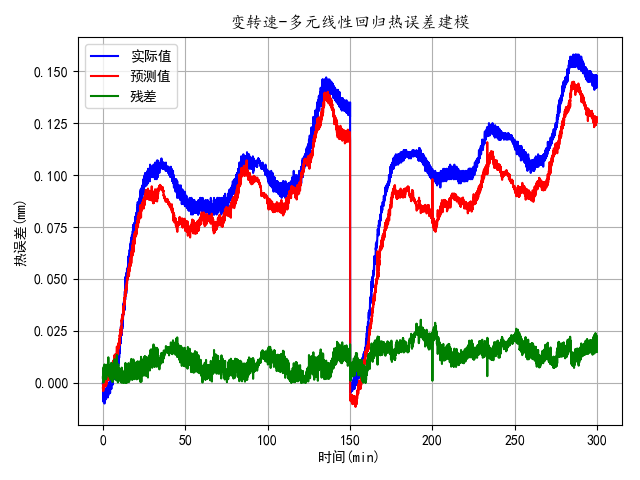

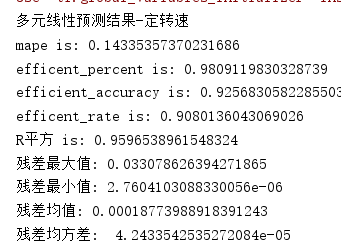

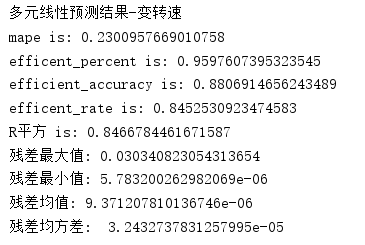

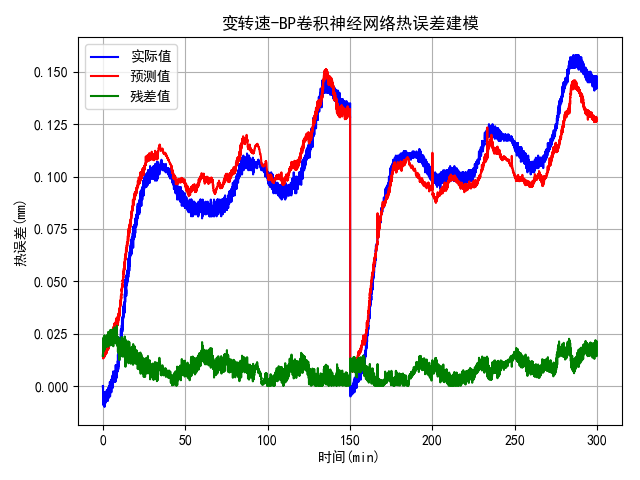

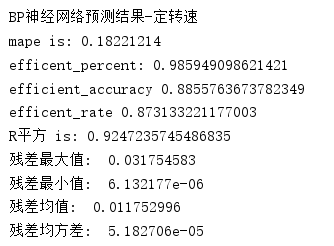

本文分析了国内外关于数控机床热误差建模的主流思想,大多关注于主轴温度,却忽略了诸如环境温度、机床转速等其他因素,因此本文通过分析数控机床热误差产生的原因,找出了能产生影响的多方面的因素,最终选定处理之后的机床温度、环境温度、机床转速和主轴温度来构成热误差数据,建立了基于此的数控机床热误差数学模型。在建模的算法上,因神经网络模型和多元回归模型在数控机床热误差建模中能够较好地描述对应机床温度变化的热误差规律,故选择多元线性回归理论模型、BP神经网络与卷积神经网络的算法,提取数据中的特征值,来更好地完善数控机床热误差模型。在实验的对照选择上,导入定转速和变转速两类数据,以此排除一些无关变量,同时能一定程度上检验建模思路是否具有普遍性。

关键词:热误差补偿;数控机床;多元线性回归;bp神经网络;卷积神经网络

Abstract

In this paper, the main ideas of thermal error modeling for CNC machine tools at home and abroad are analyzed. Most of them focus on spindle temperature, but ignore other factors such as environment temperature, machine speed and so on. Therefore, by analyzing the causes of thermal error of CNC machine tools, this paper finds out many factors that can influence the thermal error of CNC machine tools, and finally chooses the temperature, environment temperature and machine speed after processing. The thermal error data are constructed by spindle temperature, and the mathematical model of thermal error of NC machine tools based on the data is established. In the algorithm of modeling, because the neural network model and the multivariate regression model can better describe the thermal error law corresponding to the change of machine tool temperature in the thermal error modeling of NC machine tools, the multivariate linear regression theory model, the algorithm of BP neural network and convolution neural network are selected to extract the characteristic values in the data, so as to better improve the thermal error model of NC machine tools. In the comparison of experiments, two kinds of data, constant speed and variable speed, are imported to exclude some irrelevant variables, and at the same time, the universality of modeling ideas can be tested to a certain extent.

Key Words: Thermal Error Compensation; CNC Machine Tool; Multivariate Linear Regression; BP Neural Network; Convolutional Neural Network

目 录

摘要 I

Abstract II

第1章 绪论 1

第2章 神经网络,数控机床及热误差 3

2.1 神经网络的发展历程 3

2.2神经网络的特性 4

2.3 神经网络的分类 4

2.4 bp神经网络 5

2.5 卷积神经网络 5

2.6 多元线性回归理论 7

2.7 数控机床中国发展史 7

2.8 数控机床误差补偿法研究现状 8

第3章 热误差建模与实验结果 10

3.1 多元线性回归 10

3.1.1 多元线性回归理论的建模方法 10

3.1.3 实验结果 12

3.2 BP神经网络 13

3.2.1 BP理论模型 13

3.2.2 实验结果 15

3.3 卷积神经网络实验结果 16

总结 18

致谢 19

参考文献 20

第1章 绪论

在科学技术飞速进步,人类文明空前繁荣的今天,机械制造业迎来了全新的挑战。随着计算机数值控制技术的快速发展,CNC的性能也随之日益改善,它可适用的范围也在每天扩大。CNC的大范围的推广影响了生产、产业结构和机械制造业管理模式的深刻变化。自动化制造、灵活性制造和整合的最重要的因素还是得回到数字化控制上来。当前常用的计算机辅助设计、计算机辅助制造、柔性制造系统和计算机集成制造系统都离不开数字化控制技术。因此,数字化控制技术的好与坏俨然是考验一个国家一个名族工业化水平的显著参数。当下,数字化控制机床的发展方向是多样的、全面发展的,效率搞、准确度高、并行、网络、绿色缺一不可。但是,在实际处理中会产生越来越复杂的部件,加工困难越来越难,精度要求也越来越高。根据这个,设备制造业经常,面向柔软高速且高精度的开发,满足新的需求。

现代产业的不断发展给当今社会带来了很多革新,其中影响最大之一便是现代制造业,现代制造业是由一个个细小的零件组建起来的,众多本身精密的仪器它的组成零件更是要求精益求精,这些机械零件能否被较为理想的加工出来主要是由机床的加工精度决定的,机床的加工精度达标,那么机械零件的精度就能达标,组建起来的机械产品自然也能达到质量标准。同样地,机床的加工精度也由机床误差决定,机床的误差主要是热误差、切削力误差和几何学的误差,其中对机床精度影响最大的就是热误差,尤其是对于高精度高要求的机械产品,不仅如此,热误差还对产品的生产效率和成品有直接关系。几何学的误差在机床制造的源头就可以完全杜绝,在高度发达的现代机床制造业已经能完全避免几何学的误差。与此同时,作为影响机床加工精度的最大魔头热误差却一直找不到一个很好的解决方案,所以,各界人士始终想找到一个方法来减少热误差、避免热误差。

热误差,一般是说由于装置和机械的热变形所引起的加工误差或运动误差,而引起与理想情况不相符合的差异。通常情况下,我们所指的误差基本都是指机床的热误差。CNC机床的热误差,是指根据某种操作规则与机床的实际响应和由于机床的热变形引起的操作规则被期待的响应的差异。许多研究表明,热变形误差是CNC机床的最大误差源,占比达到百分之四十到百分之70。因此,由于热变形导致精度降低的问题越来越显著。由此可见,那些精密度较高的机床特别仰仗热误差控制技术,能否控制热误差将影响这些机床的成败,尤其是对于那些高速高精度的数控机床。

(l)内部热源,作为CNC机床精度的最大杀手,体现在各种发热元件包括电动机、摩擦运动和切削热等之中。其中,摩擦运动占比较大,诸如齿轮、轴承等的发热。

(2) 机床的热变形则涉及机床的多个重要部件的温度变化。为了测量机床的整体温度,必须在机床上配置几个温度测量点。通过数据处理和计算,在机床上找到了与热变形良好相关联的重要温度测量点,最终用于热误差模型。

(3)热变形位移场是多温度变量的函数。研究结果表明:神经网络模型和多元回归模型在CNC热误差建模中能够较好地描述对应于机床温度变化的热误差规律。

(4) 降低机床的热误差的方法是结构优化、热源削减、发热元件分离、实时温度测量补偿。最好是在最初的几个措施之后,再用数值控制装置来补偿热误差。

CNC机床是数字控制机床(Computer numerical control machine tools)的简称,是一种具有程序控制系统的自动机床。控制系统的作用是能够具有逻辑性地处理具有控制编码命令或其它符号编码命令的代码程序,并能对它们进行解码,使用编码的数字表示经由信息载波输入NC装置。NC装置发送各种控制信号,控制工作机械的移动,根据图纸要求的形状和大小自动地处理部件。

数控机床是一种灵活高效的自动机床工具,它不但能够解决一些复杂、准确、小批量和多种零件处理问题,节省时间提高效率,还代表着现代机床控制技术的开发方向,是具有代表性的机械产品之一。

第2章 神经网络,数控机床及热误差

神经网络从1980年代那个信息化萌芽的时代开始便成为人工智能领域的研究热点,不在直观片面的观察人类神经电路网,而是从信息处理的角度出发,使用最简易的连线,用不一样的连接方式组成迥异的模块。在使用的过程中,人们习惯性的叫它神经网络,或者称之为类神经网络。神经网络正如同人大脑内部的连接方式一样,是连接无数个节点(或神经元素)的复杂运算模型,每个节点都可以表示某个特定输出函数,或者是逻辑性的战略表现。

近10年来,人工神经回路网的研究不断深化,取得了长足的进步。在智能识别、未来机器人、预测的方面取得了前所未有的成就,并且在其他交叉学科诸如推定、生物学、医学、经济等领域,从根本上处理了许多现代计算机难以处理的实用问题,初步彰显了其实用性。

2.1 神经网络的发展历程

1943年,两位人工神经网络的开拓者与先行者,马库洛和派斯,完善了叫做“似脑机器”的突破性的方案,这种方案启发于生物神经元特性,并在此基础上,由此思想来创造性的提出神经网络, 这就是神经网络第一次概念性的提出。早在这个时候,表示大脑基本组成部分的神经元模型,就已经被他们构造出来了,且这个模型已经表现出对逻辑操作系统的通用性。

在大脑与计算机马不停蹄地研究发展的同时,研究目标也随着时代的进步与需求从“似脑机器”渐渐转变为“学习机器”, 为此,一直关心神经系统适应律的学者,霍普提出了一种新的学习模型。与此同时,瑞普生命名感知器。

怀德安提出的自适应线性元和四温恩等人提出的学习矩阵,在1960年代初期,被容纳进了用于学习系统的设计内容中去。在感知器刚刚进入人们视野中的时候,因为其便于理解便于认识,人们对它寄予了很大的期望,但是过了一段时间,感知器从数学上被证明逻辑功能的复杂性导致其在感知器上是行不通的。

到了1970年代,格洛斯堡和科恩在对神经网络的研究过程中,做出了进一步的重要的贡献。他们二位基于生物学的基础和心理学的证据,格洛斯伯格提出了一些新的非线性动力系统结构。系统的网络动力学采用了一次微分方程式模型,网络结构通过模式凝集算法的自我组织神经实现。根据神经组织的各种模式的自我调整的思想,发展了关于他的自我组织基准测定的研究活动。沃泊斯在1970年代开发了一种逆传播算法,Hopfield引进了基于神经相互作用的递归神经网络,即大名鼎鼎的Hopfield网络。

80年代中期,作为一种前馈神经网络的学习算法,帕克和鲁梅尔哈特等人重新发现了反向传播算法。这十年来,神经网广泛应用于家用电器、工业对象等领域。主要应用领域包括模式识别、图像处理、自动控制、机器人技术、信号处理、管理、商业、医疗、军事等领域。

2.2神经网络的特性

因为神经网络具有高并联结构和并行安装能力,所以耐故障性和高效处理复杂数据能力,同时由于由于神经网络本身内部结构导致的固有的非线性的特征,这个特征带来处理非线性问题的新的希望。通过训练进行学习。研究学习系统过去的一些工作数据记录,是神经网络进行自我训练进化的基础,这使得经过适当训练的网络获得超乎人类的一定意义上的学习能力和无与伦比的总结数据的能力,使得神经网络获得了处理大量复杂的含有某种内在关联的数据的能力。神经网络可以很好地契合实时工作,能够决定数目和性质的运行, 它不仅仅在软件上能完成工作,还可以通过硬件完善功能实现并行处理。近年来,一些超大规模集成电路实现的硬件出现了,可以从市场上购买。这使神经网络成为快速且大规模的处理网络。

显然,神经网络可在智能系统中用于学习和适应、自我组织化、功能近似、大规模并行处理的能力。在模型识别,信号处理,系统同定,优化中的神经网络的应用被很盛地研究。在控制领域,将神经网络应用于控制系统,处理控制系统的非线性和不确定性,近似系统的同定函数。

2.3 神经网络的分类

人工神经网络的模型可以用各种各样的方法进行分类。其中,根据网络连接的拓扑结构和网络内的信息流程分类,是较为常见的两种分类方法。根据网络拓扑结构,即神经元之间的连接,根据这个领域,神经网络的结构可以分为层次结构和相互连接结构两种。阶层型神经网络将神经元分割成输出层、中间层(隐藏层)和输出层,并按照其功能和顺序输出。输出层中的每个神经元接收来自外部世界的输入信息,并将其传递到作为神经网络的内部信息处理层的中间隐藏层神经元,从而成为信息转换的原因。根据需要,可以设计成一个或多个层。最后的隐藏层向输出层神经元传达信息,在随后的处理之后,将信息处理结果输出到外界。

2.4 bp神经网络

人工神经网络不需要预先确定输入和输出之间的成像关系的数学方程式。它通过自己内部的信息处理学会处理原始信息,获得原始信息时得到人们理想中的结果。作为一个拟生的系统,算法是它在工作中的核心思想,BP神经网络将误差反向传播,并训练内部节点,以此完成工作的多层前馈网络,这个整个过程是一种算法,名曰bp算法,基本的想法是坡度下降法,其中的梯度搜索技术用于将实际输出值的平均均方差和网络预期的输出值降到最小。

bp算法包含很多内容,但最基础的两个过程,是信号的前向传播和错误的逆传播。即,在计算误差输出的情况下,采用从输入到输出的方向,从输出到输入进行权重和阈值的调整。当产生前向传播时,输入信号经由非线性层作用于输出节点,经由非线性变换生成输出信号。如果实际输出与预期输出不匹配,则错误会转移到反传播过程。误差反传播是输出错误从隐藏层向输入层一个一个的传输,并且,错误被分配给各层的全部的单位。在反复学习和训练之后,确定对应于最小误差(权重、阈值)的网络参数,并停止训练。此时,经训练的新式网络可自行处理类似样本的输入信息。

2.5 卷积神经网络

卷积神经网络(Convolutional Neural Networks, CNN)是一种具有深层结构和卷积计算的前馈神经网络,是深刻学习的代表性算法之一。卷积型神经网络具有表征学习的能力,根据其层次结构可以对输入信息进行平移分类,因此也被称为平移不变的人工神经网络。

卷积神经网络的研究始于1980年代和1990年代。21世纪以后,随着深层学习理论的引进和数值计算装置的改进,卷积神经网络急速发展,在电脑视觉、自然语言处理等领域广泛使用。

建立模仿生物学的卷积型神经网络的视觉识别机构,可以应用在监督学习和非监督学习,这之中隐藏层内的卷积内核参数的共享和层间相互连接的疏散,用于学习具有较少的计算劳力,例如,像素和音频的网格功能,其具有不对数据的附加功能工程要求的稳定效果。

卷积神经网络的研究可以追溯到日本学者福岛Bangyan提议的猫古尼多朗模型。1979年和1980年的论文中,福岛的生物视觉皮质设计了“猫古尼多龙”这一神经网络。猫古尼多龙是具有深层结构的新网络,是早期提出的深层学习算法之一。隐藏层交替构成s层和c层。C层单元提取受体字段内的图像特征,而C层单元响应于从不同受体字段返回的相同特征。猫古尼多龙的s和c层的组合可以部分实现卷积神经网络的卷积层和环层的功能,提取被认为是暗示卷积神经网络的先驱研究的特征,并进行屏幕化。

最初的卷积神经网络是由亚历山大Alexander Waibel等于1987年提出的时间延迟网络。TDNN是用于语音识别的卷积式神经网络。作为输入,使用FFT前处理语音信号。该隐藏层由两个1维卷积内核组成,以提取频域中的翻译不变特征。在TDNN出现之前,人工智能领域进行了破解反向算法的研究,TDNN可以用BP框架来学习。在原作者的比较实验中,TDNN在同一条件下凌驾于马尔科夫模型,后者是1980年代的主流语音识别算法。

1988年,Wei Zhang提出了第一个二维折叠神经网络,平移不变的人工神经网络,并将其应用于医学图像检测。独立于Zhang,Yann Lecun还建立了LeNet原版本的卷积式神经网络,1989年应用为图像分类,有两个卷积层和两个完整的连接层,共计6万个学习参数,远远大于TDNN和SIANN,并且非常接近现代嵌入式神经网络的结构。随机初始化后,Lecun将被广泛用于学习随机初始化后的详细学习研究。另外,LeCun在讨论网络结构时,首次使用了“卷积”这个词,因此,名称“卷积神经网络”。

Lecun的工作是1993年由贝尔研究所完成的,在许多NCR检查阅读系统中展开的。然而,一般而言,为了有限的数值计算功率和不足的学习样本,为该期间的各种图像处理问题而设计的卷积型神经网络仅停留在研究阶段,不被广泛使用。

基于LeNet,Yann Lecun和他的合作者在1998年建立了完整的卷入式神经网络Lenet - 5,并成功地识别了数字。Lenet - 5根据Lecun的学习战略,为过滤输入功能向原创设计添加了环层。LENET - 5及其后变形定义现代嵌入式神经网络的基本结构,可以认为在该结构中的交替叠加环层对提取输入图像的并行不变的特征有效。lenet-5的成功受到了卷入式神经网络的应用的关注,微软于2003年开发出采用卷入式神经网络的光学式文字读取系统,还开发了基于卷积式神经网络的其他应用,包括卷积识别、肢体识别等。

2006年以后,随着深层学习理论的完成,特别是层次学习和参数微调整技术的出现,卷入型神经网络快速发展,加深结构,介绍了各种各样的学习和最优化理论。自2012年Alexnet以来,各种卷积型神经网络多次荣获Imagenet大规模视觉竞赛,包括2013年的ZFNET、2014年的VGnet、Google Lenet和2015年的Res网络,这些无一不展现出卷积神经网络算法的独特优越性。

2.6 多元线性回归理论

一元线性回归是描述独立变量的变化的独立变量的主要影响因子。在实际研究中,从属变量的变化常常受到一些重要因素的影响。此时,为了说明自变量的变化,需要使用两个以上的影响因子作为独立变量,这个作为多元回归名称的由来。在多重独立变量与从属变量之间有线性关系的情况下,回归分析是多变量回归。

我们在建立多元线性回归的理论模型时,为了保证回归模型的特色,充分发挥其优秀的说明能力和预测效果,首先应该注意的是选择一个合适的独立变量,选择的基准如下:

以上是毕业论文大纲或资料介绍,该课题完整毕业论文、开题报告、任务书、程序设计、图纸设计等资料请添加微信获取,微信号:bysjorg。

相关图片展示: