训练集的自适应去污: 区分性视觉跟踪的统一公式外文翻译资料

2022-08-08 19:29:16

英语原文共 9 页,剩余内容已隐藏,支付完成后下载完整资料

训练集的自适应去污:

区分性视觉跟踪的统一公式

Martin Danelljan, Gustav Hager, Fahad Shahbaz Khan, Michael Felsberguml;

瑞典林雪平大学电气工程系计算机视觉实验室{{martin.danelljan,gustav.hager,fahad.khan,michael.felsberg}@liu.se

摘要

近年来,利用检测方法进行跟踪已显示出很强的竞争力。在这些方法中,跟踪模型在很大程度上依赖于训练集的质量。由于标记训练数据的数量有限,需要由跟踪器自身提取和标记额外的样本。这通常会导致包含损坏的训练样本,原因是遮挡、错位和其他干扰。现有的检测跟踪方法要么忽略这个问题,要么使用单独的组件来管理训练集。。

我们提出了一种新颖的通用方法来缓解跟踪检测框架中训练样本损坏的问题。我们的方法通过估计样本的质量来动态管理训练集。与现有方法相反,我们通过最小化目标外观模型和样品质量权重的单一损失来提出了一个统一的公式。联合公式可以在增加正确样本影响的同时,对损坏的样本进行向下加权。实验在三个基准上进行:OTB-2015(带100个视频),VOT-2015(带60个视频)和TempleColor(带128个视频)。在OTB-2015上,我们统一的公式显著改善了基线,平均重叠精度提高了3.8%。 最后,我们的方法在所有三个数据集上都获得了最新的结果。 代码和补充材料可从以下网址获得:

//www.cvl.isy.liu.se/research/objrec/ visualtracking / decontrack / index.html.

1.引言

一般视觉跟踪是仅在给定初始位置的情况下估计图像序列中目标轨迹的问题。 跟踪方法是各种视觉系统的重要组成部分。 由于关于目标的先验知识有限,该问题尤其具有挑战性。此外,跟踪模型必须可以灵活应对快速的目标外观变化,同时对遮挡物和背景杂波等具有鲁棒性。

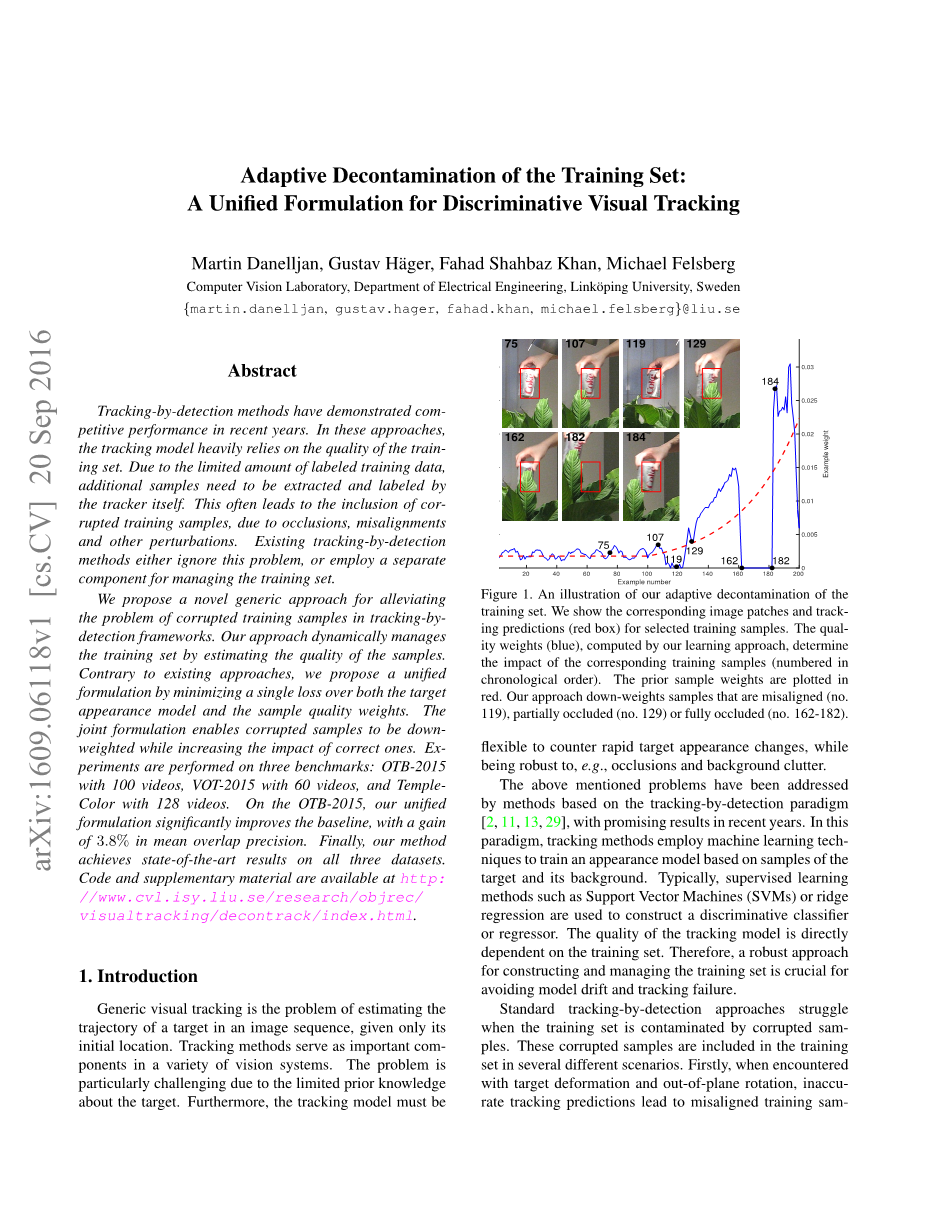

图1.我们对训练集进行自适应除杂的示意图

我们显示了所选训练样本的相应图像补丁和跟踪预测(红色框)。 由我们的学习方法计算出的质量权重(蓝色)确定了相应训练样本(按时间顺序编号)的影响。 先前的样品权重以红色绘制。 我们的方法对未对齐(第119号),部分遮挡(第129号)或完全遮挡(第162-182号)的样本进行加权。

上述问题已经通过基于检测跟踪范式的方法得以解决[2、11、13、29],并取得了预期的效果。在此范例中,跟踪方法采用机器学习技术来基于目标及其背景的样本训练外观模型。通常,使用监督学习方法(例如支持向量机(SVM)或岭回归)来构造判别式分类器或回归器。跟踪模型的质量直接取决于训练集。 因此,建立和管理训练集的鲁棒方法对于避免模型漂移和跟踪失败至关重要。

当训练集被损坏的样本污染时,标准的检测跟踪方法难以实现。这些损坏的样本包含在多个不同场景的训练集中。首先,当遇到目标变形和平面外旋转时,不正确的跟踪预测会导致训练样本的误差(图1中的119号)。因此,模型经常漂移,最终导致跟踪失败。其次,遮挡和杂波会干扰背景信息对正训练样本的影响,从而降低了模型的判别力(图1中的编号162)。在这项工作中,我们旨在通过解决对训练集进行除杂的问题来增强标准的“按检测跟踪”方法的鲁棒性。

现有的判别跟踪器要么忽略样本损坏的问题[2、11、26],要么采用显式的训练样本管理组件[9、14、16、25、29]。一种直接的方法是直接丢弃不符合特定条件的样本[1]。其他方法使用专家组合[16、29],单独的跟踪模型[14、22]或距离比较[9]的组合来管理训练集。在本文中,我们认为标准的二元策略由于对启发式算法的依赖而处于次优状态。相反,我们重新研究了标准的“跟踪检测”公式,目的是在学习中整合样本质量权重的估计。

1.1.贡献

我们提出了一种新的公式来共同学习跟踪模型和训练样本权重。我们的方法是通用的,可以集成到常见的有监督学习方法中。在每一帧中,关节损失被最小化以更新模型参数和重要性权重。如图1所示,我们的联合学习方法在权衡损坏的样本的同时,也增加了正确样本的重要性,与以前的跟踪方法不同,我们的统一公式消除了对显式样本管理组件的需求。

为了验证我们的方法,我们在三个基准上进行了广泛的实验:带100个视频的OTB-2015 [27],带60个视频的VOT-2015 [17]和带128个视频的Temple-Color [20]。我们的统一方法表明,与基线相比,OTB-2015的平均重叠精度显著提高了3.8%。此外,我们的跟踪器在所有三个数据集上都获得了最新的结果。

2.判别跟踪方法

近年来,基于检测的判别式跟踪方法[2、11、13、25、29]在基准上显示了令人鼓舞的结果,例如OTB [28]和VOT [18]。“检测跟踪”框架内的外观模型通常基于经过判别训练的回归器[2、11、13]或分类器[25、29]。这些方法是在有监督的学习环境中制定的,其中从序列中收集标记的训练样本。给定一组n个训练示例,目的是找到外观模型的参数theta;isin;Omega;。在此,xjisin;X表示样本空间X中的特征向量,yjisin;Y是标签集Y中的对应标签。跟踪[2,11,13,29]中的许多监督学习方法都是通过最小化来找到参数值theta;表格丢失,如式2.1所示

n

J(theta;) = XL(theta;;xj,yj) lambda;R(theta;). (1)

k=1

其中,L:Omega;times;Xtimes;Y→R根据参数theta;指定训练样本(xj,yj)的损失L(theta;; xj,yj)。 正则化函数R:Omega;→R的影响由恒定权重lambda;ge;0控制。

(1)涵盖了多种学习方法,包括支持向量机(SVM)[11、25、29]和判别相关滤波器(DCF)[3、4、5、13]。 常见方法[16、25、29]是使用两类学习策略来区分目标yj = 1和背景yj = -1。 或者,基于DCF的跟踪器[5、13]利用连续标签yjisin;[0,1]或让yj为图像区域上的期望置信度图。 另一种策略[11]是让Y为目标框的可能变换。

2.1. 训练样本权重

在判别跟踪中,使用从视频帧收集的训练样本学习模型。通常,训练集会在每个帧中使用新样本进行更新,以说明目标和背景外观的变化。我们重写式2.1以突出显示在许多跟踪方法中使用的这种时间采样。令(xjk,yjk)表示帧号k中的第j个训练样本。假设训练集中包含来自帧kisin;{1,...,t}的nk个样本,其中t表示当前帧号。通常,基于估计的目标位置,在帧k中提取正样本和负样本(xjk,yjk)。 损失式2.1然后以更一般的形式表示:

t nk

J(theta;) = Xalpha;k XL(theta;;xjk,yjk) lambda;R(theta;). (2) k=1 j=1 (2)

其中,恒定权重alpha;kge;0控制来自帧k的样本的影响。通过增加alpha;k,对从帧k提取的样本的影响更大。

在(2)中,存在几种控制训练样本影响的策略。在基于DCF的跟踪器[2、13]中,学习率参数gamma;isin;[0,1]用于将权重更新为alpha;k=(1-gamma;)alpha;k 1。这种重新加权策略旨在减少旧样本对学习的影响。基于SVM的跟踪器通常会修剪例如拒绝大于阈值的样本[26]或删除影响最小的支持向量[11]。但是,这些方法不能解决训练集中样本(xjk,yjk)损坏的问题。

2.2.损坏的培训样本

与物体检测相反,跟踪中经常会遇到训练样本损坏的问题。出现问题是因为样本不是手工标记的,而是由跟踪算法本身标记的。有几个因素导致在学习中无意中包含了损坏的训练样本:(a)由于例如目标旋转或变形等情况导致的样品未对准,这可能会导致模型漂移或跟踪失败。(b)部分或完全遮挡目标物会导致正样本被遮挡物破坏。这是跟踪失败的常见原因,因为外观模型由于遮挡而被污染。(c)诸如运动模糊之类的干扰会导致目标的视角失真。这些因素有助于将损坏的训练样本包含在学习中,从而降低模型的判别力。

最新技术:最近的一些工作已经研究了按跟踪检测范式[1,16,25,29]中训练样本损坏的问题。Bolme等[1]建议根据峰对西德罗比(PSR)准则拒绝新样本。 PSR计算为最大置信度得分与周围得分的标准偏差(在峰的指定邻域之外)之间的比率。张等[29]使用基于熵的最小化来确定专家组中的最佳模型。该集合由当前的跟踪模型和早期帧的快照组成。如果发生分歧,则选择具有最小熵标准的专家作为新的跟踪器模型。 Kalal等[16]通过基于空间和时间约束产生正负样本来解决漂移问题。 Supancic和Ramanan[25]提出了一种通过重新访问先前被拒绝的样本来更新训练集的策略。 Hong等 [14]使用基于关键点的长期记忆组件来检测遮挡并刷新短期记忆。

与我们的方法的区别:如上所述,现有的按检测跟踪的方法使用专用的单独组件解决了损坏的样本的问题。该组件基于距离比较[9],启发式[1,30],一组专家[16,29],单独的跟踪模型[14]或模型拟合[25]。我们的方法在几个方面与前述方法不同。据我们所知,我们是第一个提出一种学习公式,可以共同优化模型参数和样本权重。我们的方法不是基于二元决策[1、16、25、29],而是基于连续重要性权重。这使我们能够降低加权的训练样本的影响,同时提高正确样本的影响。此外,我们的方法允许通过重新确定每一帧的样本权重来纠正错误。

3.我们的方法

在这里,我们提出我们的公式,以便在检测跟踪框架中共同学习外观模型和训练样本权重。

3.1.目的

为了测试我们的方法,我们首先要区分设计训练集净化方法时要考虑的三个理想特征。连续权重:大多数现有的判别跟踪器[1、16、25、29]都依赖于包含或移除潜在训练样本的二进制决策。这在模棱两可的情况下是有问题的,例如适度的咬合或轻微的偏差(见图1),其中提取的样本并未完全损坏,仍然包含有价值的信息。相反,连续的质量权重有望更准确地说明此类样本的重要性。重新确定重要性:一种常见的方法是仅基于先前帧来确定样本的重要性,例如根据当前外观模型拒绝新样本[1]。理想情况下,在更新特定训练样本的重要性时应考虑所有可用信息,包括最新框架。通过利用所有观察到的帧中的信息,可以更准确地重新确定较旧样本的重要性。这将使先前的错误在跟踪过程的后续阶段得以纠正。动态样本优先:纯粹基于自下而上统计的方法会忽略与样本相关的先验知识。在目标快速变形和旋转的情况下,跟踪器应强调近期样本以增强稳健性。动态先验知识是自下而上信息的补充,有望改善性能。

3.2. 问题表述

我们的方法共同估计模型参数theta;和权重alpha;k。 这是通过最小化单个损失函数J(theta;,alpha;)来学习外观模型theta;和训练样本权重alpha;=(alpha;1,...,alpha;t)来实现的。 据我们所知,我们是第一个在联合优化框架中提出确定样品质量的问题的。下面我们引入了联合损失J(theta;,alpha;),如(3):

(3a)

|

subject to |

alpha;k ge; 0, k = 1,...,t t |

(3b) |

|

X alpha;k = 1. |

(3c) |

与标准加权损失(2)不同,(3a)是模型参数theta;和样本权重alpha;k的函数。 结果,权重alpha;k不再是预定常数。 约束(3b)和(3c)确保权重alpha;k为非负且总和为1。 联合损失(3a)中的第二项是样本权重alpha;的正则项。该正则性由灵活性参数micro;gt; 0和先前样本权重rho;kgt; 0来控制,满足Pkrho;k=1。参数micro;控制示例权重alpha;的自适应性。micro;的增加导致权重alpha;的灵活性更高。我们通过考虑增加(mu;→infin;)和减小(mu;→0)柔韧性参数的极端情况来分析mu;和rho;k的影响。

micro;→infin;的情况:这对应于删除(3a)中的第二项,这意味着不对alpha;进行正则化。 对于固定的模型参数theta;,然后通过为总损耗最小的帧m设置alpha;m= 1并为k 6 = m设置alpha;k= 0来最小化损耗。如果删除了(3a)中的第二项,则该模型将过度拟合单个帧k = m的样本。 因此,必须对权重alpha;使用正则化。

micro;→0的情况:通过引入拉格朗日乘数,可以证明对于固定的theta;,当micro;→0时alpha;k→rho;k。

因此,减小参数mu;也减小了权重alpha;k关于先前权重rho;k的灵活性。 因此,通过设置alpha;k=rho;k,可在极限micro;→0中获得标准加权损失(2)。 通过引入灵活的样本权重alpha;k,我们的方法可以看作是(2)的概括。

3.3.优化

在这里,我们提出了一种解决联合学习问题的策略(3)。我们的方法通过在模型参数theta;和示例权重alpha;之间进行交替来最大程度地减少损失。在给定任何固定theta;的情况下,(3)的权重alpha;都是凸的,从而激发了这一策略。此外,许多现有的监督学习方法,例如SVM和DCF,都依赖于凸优化问题(1)。如果加权损失(2)是凸的,则可以直接验证(3

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[240349],资料为PDF文档或Word文档,PDF文档可免费转换为Word